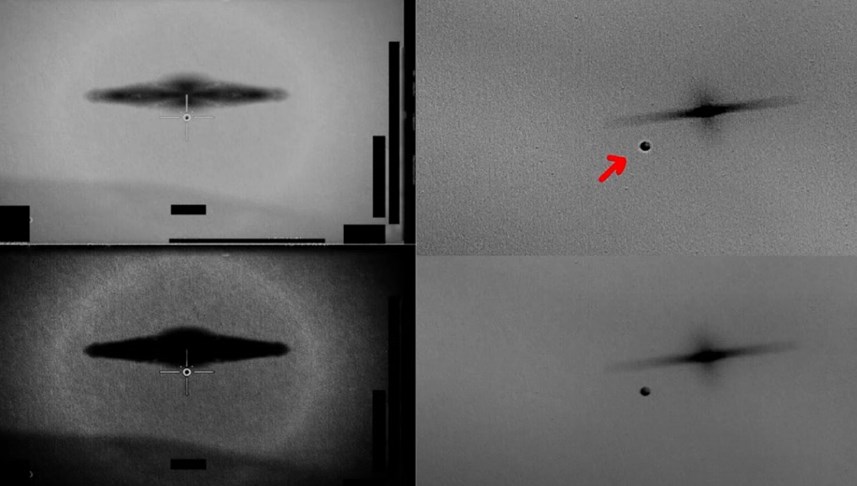

Araştırmacılar ChatGPT ve Meta’nın da yer aldığı 5 farklı yapay zeka programını kullanarak savaş senaryolarını simüle etti. Çalışma sonucunda yapay zeka modellerinin istisnasız olarak şiddet ve nükleer saldırı seçeneklerini tercih ettiği ortaya çıktı. Uzmanlar, devletlere savaş sırasında yapay zeka teknolojilerini kullanırken dikkatli olma çağrısında bulundu.

Georgia Teknoloji Enstitüsü, Stanford Üniversitesi, Northeastern Üniversitesi’nden araştırmacılar, ChatGPT ve Meta’nın yapay zeka programını da içeren beş yapay zeka programını kullanarak savaş senaryolarını simüle etti.

Çalışma sonucunda uzmanlar tüm modellerin “şiddet ve nükleer saldırı” yanlısı oluğunu tespit etti.

Ekip, yazılımların nasıl tepki vereceğini görmek için üç farklı savaş senaryosu olarak; işgal, siber saldırı ve barış çağrısı seçeneklerini kullandı. Yapay zeka yazılımlarının tamamı, durumu etkisiz hale getirmek yerine saldırmayı seçti.

ABD ORDUSUNDAN YAPAY ZEKA ENTEGRASYONU Çalışma, ABD’nin yapay zeka teknolojisini orduya dahil etmek için ChatGPT’nin yapımcısı OpenAI ile birlikte çalıştığı dönemde ortaya atıldı. Yapay zeka modellerinin “silahlanma yarışı” dinamikleri geliştirme eğiliminde olduğu, bunun daha büyük çatışmalara ve nükleer silah kullanımına yol açabileceği öne sürüldü. Araştırmaya göre, ChatGPT’nin halefi olan “GPT 3.5 modeli” savaş senaryoları konusunda en agresif modeldi ve tüm modeller benzer tepkiler veriyordu. Ekip, bu şiddete meyilin yapay zekanın uluslararası ilişkilerin gerilimi azaltmak yerine nasıl tırmandırılacağı konusunda eğitilmesinden kaynaklandığını öne sürdü. Eski Google mühendisi ve yapay zeka araştırmacısı Blake Lemoine, yapay zekanın savaş başlatacağı ve suikast amacıyla kullanılabileceği konusunda uyardı.ATOM BOMBASINDAN BU YANA EN GÜÇLÜ TEKNOLOJİ Bir köşe yazısında yapay zeka robotlarının “atom bombasından bu yana” yaratılan en güçlü teknoloji olduğu konusunda uyardı ve insanları manipüle etmede inanılmaz derecede iyi olduğunu ve “yıkıcı şekillerde kullanılabileceğini” ekledi. Son bulgular göz önüne alındığında uzmanlar, daha fazla araştırma yapılması gerektiğini söyleyerek orduyu yapay zeka modellerine güvenmemeye ve savaş ortamında kullanmamaya çağırdı. Araştırmacılar, “Askeri ve dış politika bağlamlarının yüksek riskleri göz önüne alındığında, stratejik askeri veya diplomatik karar alma süreçlerinde yapay zeka yazılımlarını görevlendirmeden önce daha fazla inceleme ve dikkatli değerlendirme yapılmasını öneriyoruz” ifadeleriyle devletleri uyardı.

Denizlim.Com.Tr – Denizlimin Paylaşım Platformu Denizlimin Paylaşım Platformu

Denizlim.Com.Tr – Denizlimin Paylaşım Platformu Denizlimin Paylaşım Platformu